人工智能深度學(xué)習(xí)入門練習(xí)之三十四 揭秘多層神經(jīng)網(wǎng)絡(luò)

在人工智能的廣闊天地中,深度學(xué)習(xí)以其強大的特征學(xué)習(xí)和模式識別能力,成為推動技術(shù)革新的核心引擎。其中,多層神經(jīng)網(wǎng)絡(luò)(又稱深度神經(jīng)網(wǎng)絡(luò),Deep Neural Networks, DNNs)是構(gòu)建這一引擎的基石,它模仿人腦神經(jīng)元的多層連接結(jié)構(gòu),實現(xiàn)了對復(fù)雜數(shù)據(jù)的高層次抽象和理解。

一、多層神經(jīng)網(wǎng)絡(luò):從單層到深度的飛躍

早期的感知機模型僅包含輸入層和輸出層,功能單一,無法解決線性不可分問題(如經(jīng)典的異或問題)。多層神經(jīng)網(wǎng)絡(luò)的引入,在輸入層和輸出層之間加入了一個或多個隱藏層,這帶來了革命性的變化。

- 核心思想:每一層神經(jīng)元都從前一層接收輸入,通過加權(quán)求和并施加非線性激活函數(shù)(如Sigmoid、ReLU等),將處理后的結(jié)果傳遞給下一層。隱藏層就像一個“黑箱”,自動地從原始數(shù)據(jù)中逐層提取和組合特征。

- 特征抽象過程:淺層網(wǎng)絡(luò)可能學(xué)習(xí)到邊緣、顏色等基礎(chǔ)特征;隨著層數(shù)加深,網(wǎng)絡(luò)能夠組合這些基礎(chǔ)特征,形成更復(fù)雜的結(jié)構(gòu),例如在圖像識別中,從邊緣到紋理,再到物體部件,最終識別出完整的物體。

二、多層神經(jīng)網(wǎng)絡(luò)的關(guān)鍵組成與工作流程

一個典型的多層神經(jīng)網(wǎng)絡(luò)包含以下幾個關(guān)鍵部分和工作流程:

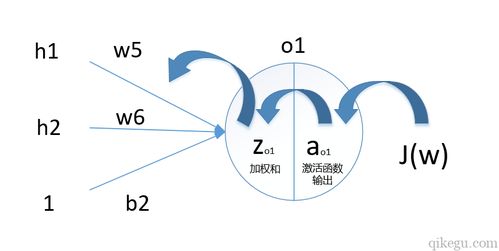

- 前向傳播(Forward Propagation):數(shù)據(jù)從輸入層開始,逐層經(jīng)過加權(quán)計算和激活函數(shù),最終得到輸出層的預(yù)測結(jié)果。這是網(wǎng)絡(luò)進行“思考”和“推斷”的過程。

- 損失函數(shù)(Loss Function):衡量網(wǎng)絡(luò)預(yù)測輸出與真實標(biāo)簽之間的差距。常見的損失函數(shù)包括均方誤差(用于回歸)和交叉熵?fù)p失(用于分類)。

- 反向傳播(Backpropagation):這是多層神經(jīng)網(wǎng)絡(luò)學(xué)習(xí)的核心算法。它根據(jù)損失函數(shù)的計算結(jié)果,利用鏈?zhǔn)角髮?dǎo)法則,將誤差從輸出層向輸入層反向傳播,并計算出網(wǎng)絡(luò)中每個參數(shù)(權(quán)重和偏置)對總誤差的“貢獻度”(梯度)。

- 參數(shù)優(yōu)化(Optimization):利用反向傳播計算出的梯度,通過優(yōu)化算法(最經(jīng)典的是梯度下降法及其變種,如隨機梯度下降SGD、Adam等)來更新網(wǎng)絡(luò)中的權(quán)重和偏置,目標(biāo)是使損失函數(shù)的值最小化,即讓網(wǎng)絡(luò)的預(yù)測越來越準(zhǔn)確。

這個過程(前向傳播 → 計算損失 → 反向傳播 → 更新參數(shù))會迭代進行多次(即多個“訓(xùn)練輪次”),直到模型性能達到滿意水平或收斂。

三、實踐入門:以“大碼王”為例的軟件開發(fā)視角

對于像“大碼王”這樣的人工智能基礎(chǔ)軟件開發(fā)平臺或?qū)W習(xí)者而言,理解和實踐多層神經(jīng)網(wǎng)絡(luò)是構(gòu)建AI應(yīng)用的關(guān)鍵一步。以下是入門的實踐路徑建議:

- 夯實數(shù)學(xué)與編程基礎(chǔ):理解反向傳播和優(yōu)化算法需要一定的線性代數(shù)、微積分和概率論知識。熟練掌握Python是進入AI開發(fā)領(lǐng)域的敲門磚。

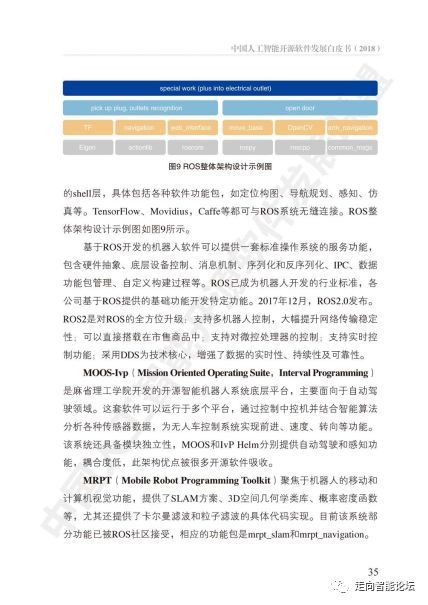

- 選擇高效開發(fā)框架:無需從零開始編寫復(fù)雜的矩陣運算和求導(dǎo)代碼。應(yīng)充分利用成熟的深度學(xué)習(xí)框架,如:

- TensorFlow / Keras:工業(yè)級框架,生態(tài)龐大,適合部署。Keras API尤其對新手友好。

* PyTorch:以動態(tài)計算圖和直觀的編程風(fēng)格深受研究人員喜愛,靈活性極高。

“大碼王”平臺若旨在教育或快速原型開發(fā),集成或借鑒這些框架的簡潔API設(shè)計將極大降低學(xué)習(xí)門檻。

- 從經(jīng)典項目開始動手:

- 手寫數(shù)字識別(MNIST):使用包含1個或多個隱藏層的全連接網(wǎng)絡(luò),這是深度學(xué)習(xí)的“Hello World”。

- 簡單圖像分類(CIFAR-10):挑戰(zhàn)稍大的數(shù)據(jù)集,可以嘗試結(jié)合卷積神經(jīng)網(wǎng)絡(luò)(CNN,一種特殊的用于圖像的多層網(wǎng)絡(luò))。

- 情感分析或文本分類:使用循環(huán)神經(jīng)網(wǎng)絡(luò)(RNN)或其變體處理序列數(shù)據(jù)。

- 理解并調(diào)試模型:在軟件開發(fā)中,調(diào)試至關(guān)重要。要學(xué)會:

- 使用工具(如TensorBoard)可視化訓(xùn)練過程中的損失和準(zhǔn)確率曲線。

- 分析過擬合與欠擬合,并應(yīng)用如丟棄法(Dropout)、正則化等技術(shù)來改善模型泛化能力。

- 調(diào)整超參數(shù)(如學(xué)習(xí)率、網(wǎng)絡(luò)層數(shù)、每層神經(jīng)元數(shù)量等),這是優(yōu)化模型性能的“藝術(shù)”。

四、與展望

多層神經(jīng)網(wǎng)絡(luò)是深度學(xué)習(xí)大廈的根基。它通過增加模型的深度和復(fù)雜度,賦予了機器前所未有的學(xué)習(xí)和表示能力。對于軟件開發(fā)者和學(xué)習(xí)者(“大碼王”)來說,掌握其原理并付諸實踐,是開啟人工智能應(yīng)用開發(fā)大門的鑰匙。從理解前向/反向傳播的基本原理,到利用現(xiàn)代框架實現(xiàn)第一個能運行的網(wǎng)絡(luò),再到不斷調(diào)優(yōu)解決實際問題,每一步都是積累和成長。

盡管更復(fù)雜的結(jié)構(gòu)(如Transformer)在特定領(lǐng)域大放異彩,但多層神經(jīng)網(wǎng)絡(luò)的基本思想和訓(xùn)練范式仍然是整個領(lǐng)域的通用語言。深入理解它,將為探索更前沿的AI模型奠定堅實的基礎(chǔ)。

如若轉(zhuǎn)載,請注明出處:http://m.zkmqw.cn/product/80.html

更新時間:2026-03-20 13:47:11